Yapay zeka sonsuz yeni fırsatlar sunarken, aynı zamanda bir dizi yeni tehdidi de beraberinde getiriyor. Üretken yapay zeka, kötü niyetli kişilerin derin sahte içerikler ve sahte web siteleri oluşturmasına, spam göndermesine ve hatta arkadaşlarınızın ve ailenizin kimliğine bürünmesine olanak tanıyor. Bu yazıda, sinir ağlarının dolandırıcılık ve kimlik avı için nasıl kullanıldığını ele alacağız ve elbette, güvenliğinizi nasıl sağlayabileceğinize dair ipuçları paylaşacağız. Yapay zeka destekli kimlik avı dolandırıcılık yöntemleri hakkında daha fazla ayrıntı için Securelist‘teki raporun tamamını inceleyebilirsiniz.

Domuz kesimi, enayi avcılığı ve deepfake’ler

Dolandırıcılar, özellikle aşk dolandırıcılığında gerçek insanlar gibi davranan yapay zeka botları kullanıyorlar. Uydurma kişilikler yaratıyor ve bunları birden fazla kurbanla aynı anda iletişim kurmak için kullanarak güçlü duygusal bağlar kuruyorlar. Bu, hafif flörtlerle başlayıp yavaş yavaş ” kazançlı yatırım fırsatları” hakkında tartışmalara dönüşerek haftalarca, hatta aylarca sürebiliyor. Uzun süreli kişisel bağlantı, kurbanın sahip olabileceği şüpheleri ortadan kaldırmaya yardımcı oluyor, ancak kurban parasını sahte bir projeye yatırdığı anda dolandırıcılık elbette sona eriyor. “Domuz kesimi” olarak bilinen bu dolandırıcılık yöntemini daha önceki bir yazımızda ayrıntılarla ele almıştık. Eskiden Güneydoğu Asya’da binlerce kişiyi istihdam eden devasa dolandırıcılık çiftlikleri tarafından yürütülürken, bu dolandırıcılık yöntemleri artık giderek daha fazla yapay zekaya dayanıyor.

Sinir ağları, dolandırıcıların sahte kimlik oluşturduğu veya gerçek bir kişinin kimliğine büründüğü enayi avcılığını (catfishing) çok daha kolay hale getirdi. Modern üretken sinir ağları, bir kişinin görünüşünü, sesini veya yazım stilini yeterli derecede doğrulukla taklit edebilir. Bir dolandırıcı için tek yapması gereken, bir kişi hakkında kamuya açık bilgileri toplamak ve bu verileri yapay zekaya aktarmaktır. Ve burada; fotoğraflar, videolar, herkese açık gönderiler ve yorumlar, akrabalar, hobiler, yaş vb. hakkında bilgiler gibi her şey yararlı olabilir.

Dolayısıyla, ailenizden biri veya bir arkadaşınız yeni bir hesaptan size mesaj gönderip, örneğin borç para isterse, bu muhtemelen gerçek bir akrabanız veya arkadaşınız değildir. Böyle bir durumda, en iyisi farklı bir yolla (örneğin telefonla) o kişiye ulaşıp her şeyin yolunda olup olmadığını doğrudan sormaktır. Dolandırıcıların çevrimiçi olarak veya geçmiş mesajlarınızda bulamayacağı birkaç kişisel soru sormak da akıllıca bir davranış olacaktır.

Ancak ikna edici metin taklidi sorunun sadece bir parçasıdır; ses ve video deepfake’leri daha da büyük bir tehdit oluşturmaktadır. Kısa süre önce, dolandırıcıların sosyal medyada popüler blog yazarları ve kripto yatırımcılarının deepfake’lerini nasıl kullandıklarını paylaştık. Bu sahte ünlüler, takipçilerini “kişisel danışmanlık” veya “özel yatırım sohbetleri”ne davet ediyor veya nakit ödüller ve pahalı hediyeler vaat ediyordu.

Ancak deepfake’lerin kullanıldığı tek yer sosyal medya değildir. Aynı zamanda gerçek zamanlı video ve sesli aramalar için de üretilirler. Bu yılın başlarında, Florida’da bir kadın, trafik kazası geçirdiği iddia edilen kızıyla konuştuğunu sanarak 15.000 $ kaybetti. Dolandırıcılar, kızının sesini gerçekçi bir şekilde taklit eden bir deepfake kullandılar ve hatta onun ağlamasını bile taklit ettiler.

Kaspersky’nin GReAT ekibindeki uzmanlar, karanlık web’de gerçek zamanlı video ve ses deepfake’leri oluşturmak için teklifler buldu. Bu hizmetlerin fiyatı, içeriğin ne kadar karmaşık ve uzun olmasına bağlı olarak; sesli deepfake’ler için 30 $’dan, videolar için ise 50 $’dan başlayan fiyatlarla sunuluyor. Sadece birkaç yıl önce, bu hizmetlerin maliyeti çok daha yüksekti (dakikası 20.000 $’a kadar çıkıyordu) ve gerçek zamanlı üretim bir seçenek değildi.

Listeler; video konferanslarda veya mesajlaşma uygulamalarında gerçek zamanlı yüz değiştirme, kimlik doğrulama için yüz değiştirme veya telefondan veya sanal kameradan bir görüntüyü değiştirme gibi farklı seçenekler sunuyor.

Dolandırıcılar ayrıca, herhangi bir metni videoda dudak hareketleri ile senkronize eden araçlar sunuyorlar; hatta yabancı dillerde bile. Ayrıca, istenen duyguya uyacak şekilde ton ve perdeyi değiştirebilen ses klonlama araçları da sunuyorlar.

Ancak uzmanlarımız, bu dark-web listelerinin birçoğunun, aslında var olmayan hizmetler için ödeme yapmaları için diğer dolandırıcıları kandırmak üzere tasarlanmış dolandırıcılıklar olabileceğinden şüpheleniyor.

Nasıl güvende kalabilirsiniz?

- Yüz yüze hiç tanışmadığınız çevrimiçi tanıdıklara güvenmeyin. Bir süredir sohbet ediyor olsanız ve “ruh eşinizi” bulduğunuzu hissetseniz bile, konu kripto, yatırımlar veya onlara para göndermenizi gerektiren başka bir uygulamaya gelirse dikkatli olun.

- Sosyal medyada ünlülerden veya büyük şirketlerden geliyormuş gibi görünen beklenmedik, cazip tekliflere kanmayın. Bilgileri iki kez kontrol etmek için her zaman resmi hesaplarına gidin. Bir “çekilişin” herhangi bir noktasında sizden bir ücret, vergi veya nakliye ücreti ödemeniz ya da nakit ödül almak için kredi kartı ayrıntılarını girmeniz istenirse durun.

- Arkadaşlarınız veya akrabalarınız size olağandışı taleplerle mesaj gönderirse, onlarla telefon gibi farklı bir kanaldan iletişime geçin. Güvende olmak için, onlara gerçek hayattaki son konuşmanız sırasında konuştuğunuz bir şey hakkında soru sorun. Yakın arkadaşlarınız ve aileniz için, önceden sadece ikinizin bildiği bir parola kelimesi üzerinde anlaşmak iyi bir fikirdir. Konumunuzu birbirinizle paylaşıyorsanız, kontrol edin ve kişinin nerede olduğunu onaylayın. Ve “acele edin” manipülasyonuna kanmayın; dolandırıcı veya yapay zeka size durumun acil olduğunu ve “aptalca” soruları yanıtlamak için zamanları olmadığını söyleyebilir.

- Bir görüntülü görüşme sırasında şüpheleriniz varsa, kişiden başını yana çevirmesini veya karmaşık bir el hareketi yapmasını isteyin. Deepfake’ler genellikle illüzyonu bozmadan bu tür talepleri yerine getiremezler. Ayrıca, kişi gözlerini kırpmıyorsa veya dudak hareketleri ya da yüz ifadeleri garip görünüyorsa, bu da başka bir tehlike işaretidir.

- Banka kartı numaralarını, tek kullanımlık kodları veya diğer gizli bilgileri asla söylemeyin veya başka bir şekilde paylaşmayın.

Kafa döndüğünde dağılan bir deepfake örneği. Kaynak

Otomatik aramalar

Bunlar, insanlarla doğrudan konuşmak zorunda kalmadan onları kandırmanın etkili bir yoludur. Dolandırıcılar bankalardan, kablosuz iletişim operatörlerinden ve devlet hizmetlerinden sahte otomatik aramalar yapmak için yapay zekayı kullanırlar. Hattın diğer ucunda sadece destek temsilcisi gibi davranan bir bot vardır. Gerçek gibi gelir çünkü birçok yasal şirket otomatik sesli asistan kullanır. Ancak gerçek bir şirket sizi asla arayıp hesabınızın ele geçirildiğini söylemez veya doğrulama kodu istemez.

Böyle bir telefon alırsanız, önemli olan sakin kalmaktır. “Hacklenmiş bir hesap” veya “çalınmış para” gibi korkutma taktiklerine kanmayın. Sadece telefonu kapatın ve gerçek şirketi aramak için şirketin web sitesindeki resmi numarayı kullanın. Modern dolandırıcılıkların sizi birinden diğerine geçiren birden fazla kişiyi içerebileceğini unutmayın. Farklı numaralardan arayabilir veya mesaj atabilir ve banka çalışanı, devlet memuru ve hatta polis gibi davranabilirler.

Kimlik avına duyarlı sohbet robotları ve yapay zeka ajanları

Birçok kişi artık bilindik arama motorları yerine ChatGPT veya Gemini gibi sohbet robotlarını kullanmayı tercih ediyor. Riskler ne olabilir diye sorabilirsiniz? Büyük dil modelleri kullanıcı verileriyle eğitilir ve popüler sohbet robotlarının kullanıcılara kimlik avı siteleri önerdiği bilinmektedir. Web aramaları yaptıklarında, yapay zeka ajanları kimlik avı bağlantıları da içerebilen arama motorlarına bağlanırlar.

Yakın zamanda yapılan bir deneyde, araştırmacılar Perplexity’nin Comet tarayıcısındaki yapay zeka ajanını sahte bir e-posta ile kandırmayı başardılar. E-posta, dünyanın en büyük bankalarından biri olan Wells Fargo’nun yatırım müdüründen gelmiş gibi görünüyordu. Araştırmacılar, yeni oluşturulan bir Proton Mail hesabından e-postayı gönderdiler. Bu bağlantı, birkaç gündür aktif olan ancak Google Güvenli Tarama tarafından henüz kötü amaçlı olarak işaretlenmemiş gerçek bir kimlik avı sayfasına yönlendiriyordu. Kullanıcının gelen kutusunu incelerken, yapay zeka ajanı mesajı “bankadan gelen yapılacaklar listesi” olarak işaretledi. Daha fazla kontrol yapmadan, kimlik avı bağlantısını izleyerek sahte giriş sayfasını açtı ve kullanıcıdan kimlik bilgilerini girmesini istedi; hatta formu doldurmasına bile yardımcı oldu! Yapay zeka, esasen kimlik avı sayfasını onayladı. Kullanıcı, şüpheli gönderenin e-posta adresini veya kimlik avı bağlantısını hiç görmedi. Bunun yerine hemen, “yardımsever” yapay zeka asistanı tarafından verilen bir parola giriş sayfasına yönlendirildi.

Aynı deneyde, araştırmacılar yapay zeka destekli web geliştirme platformu Loveable‘ı kullanarak Walmart mağazasını taklit eden sahte bir web sitesi oluşturdular. Ardından Comet’teki siteyi ziyaret ettiler. Bu, bir kimlik avı bağlantısı veya reklamla kandırılmış, hiçbir şeyden haberi olmayan bir kullanıcının kolayca yapabileceği bir şeydi. Yapay zeka ajanından bir Apple Watch satın almasını istediler. Ajan sahte siteyi analiz etti, bir “indirim” buldu, saati sepete ekledi, tarayıcıda kayıtlı adres ve banka kartı bilgilerini girdi ve herhangi bir onay istemeden “satın alma” işlemini tamamladı. Bu gerçek bir dolandırıcılık sitesi olsaydı, kullanıcılar banka detaylarını dolandırıcılara altın tepside sunarken büyük miktarda para kaybederlerdi.

Ne yazık ki, yapay zeka ajanları şu anda web’de gerçek yeni kullanıcılar gibi davranıyor ve sosyal mühendisliğe kolayca kanıyorlar. Daha önce, yapay zekayı tarayıcılara entegre etmenin riskleri ve bu riskleri en aza indirmenin yolları hakkında detaylıca konuşmuştuk. Ancak, yapay zeka asistanlarına gereğinden fazla güvenen bir sonraki kurban olmamak için, asistanın sağladığı bilgileri eleştirel bir gözle değerlendirmeli, yapay zeka ajanlarına verdiğiniz izinleri sınırlamalı ve kötü amaçlı sitelere erişimi engelleyecek güvenilir bir güvenlik çözümü yüklemelisiniz.

Yapay zeka tarafından oluşturulan kimlik avı web siteleri

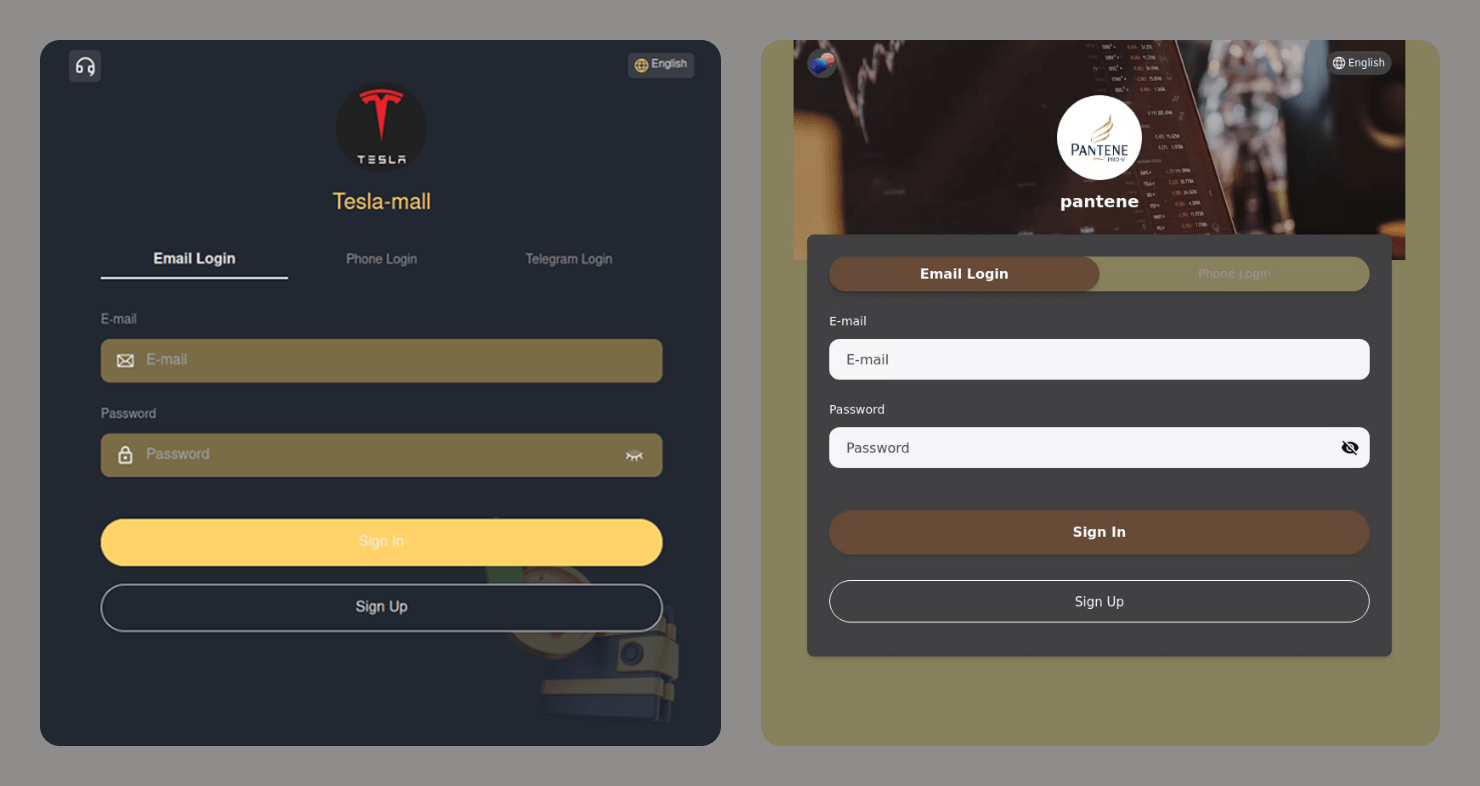

Gizli reklamlarla dolu, kötü tasarlanmış, güvenilmez kimlik avı sitelerinin günleri çoktan geride kaldı. Modern dolandırıcılar, HTTPS iletişim kurallarını kullanan, kullanıcı sözleşmelerini ve çerez onay uyarılarını gösteren ve oldukça iyi tasarımlara sahip gerçekçi sahte siteler oluşturmak için ellerinden geleni yapıyorlar. Yapay zeka destekli araçlar, bu tür web sitelerinin oluşturulmasını neredeyse anında olmasa da çok daha ucuz ve hızlı hale getirmiş durumda. Bu sitelerin bağlantılarını her yerde bulabilirsiniz; kısa mesajlarda, e-postalarda, sosyal medyada ve hatta arama sonuçlarında.

Kimlik avı siteleri nasıl tespit edilir?

- URL, başlık ve içeriği yazım hataları açısından kontrol edin.

- Web sitesinin alan adının ne kadar süredir kayıtlı olduğunu öğrenin. Bunu buradan kontrol edebilirsiniz.

- Dile dikkat edin. Site sizi korkutmaya veya suçlamaya mı çalışıyor? Sizi cezbetmeye mi çalışıyor ya da aceleyle harekete geçmeye mi zorluyor? Her türlü duygusal manipülasyon büyük bir tehlike işaretidir.

- Güvenlik çözümlerimizden herhangi birinde bağlantı kontrol özelliğini etkinleştirin.

- Tarayıcınız güvenli olmayan bir bağlantı konusunda sizi uyarıyorsa, siteden ayrılın. Yasal siteler HTTPS protokolünü kullanır.

- Web sitesi adını çevrimiçi olarak arayın ve bulduğunuz URL’yi arama sonuçlarındaki URL ile karşılaştırın. Dikkatli olun, arama motorları sayfanın üst kısmında sponsorlu kimlik avı bağlantıları gösterebilir. Bağlantının yanında “Reklam” veya “Sponsorlu” etiketi olmadığından emin olun.

Yapay zekayı güvenli bir şekilde kullanma hakkında daha fazla bilgi edinin:

kimlik avı

kimlik avı

İpuçları

İpuçları