Bir kuruluş, kendi kullandığı yapay zeka ajanlarının tehlikeli eylemlerinden nasıl korunabilir? Bu artık sadece teorik bir varsayım değil; otonom yapay zekanın verebileceği gerçek zarar, kötü müşteri hizmetinden şirketlerin birincil veri tabanlarının yok edilmesine kadar uzanıyor. Bu, iş dünyasının liderlerinin şu anda üzerinde yoğun bir şekilde çalıştığı bir soru ve devlet kurumları ile güvenlik uzmanları bu soruya cevap bulmak için yarışıyor.

CIO’lar ve CISO’lar için, yapay zeka ajanları büyük bir yönetim sorunu yaratıyor. Bu ajanlar, insan müdahalesi olmadan kararlar alıyor, araçlar kullanıyor ve hassas verileri işliyorlar. Sonuç olarak, standart BT ve güvenlik araçlarımızın çoğunun yapay zekayı kontrol altında tutamadığı ortaya çıkıyor.

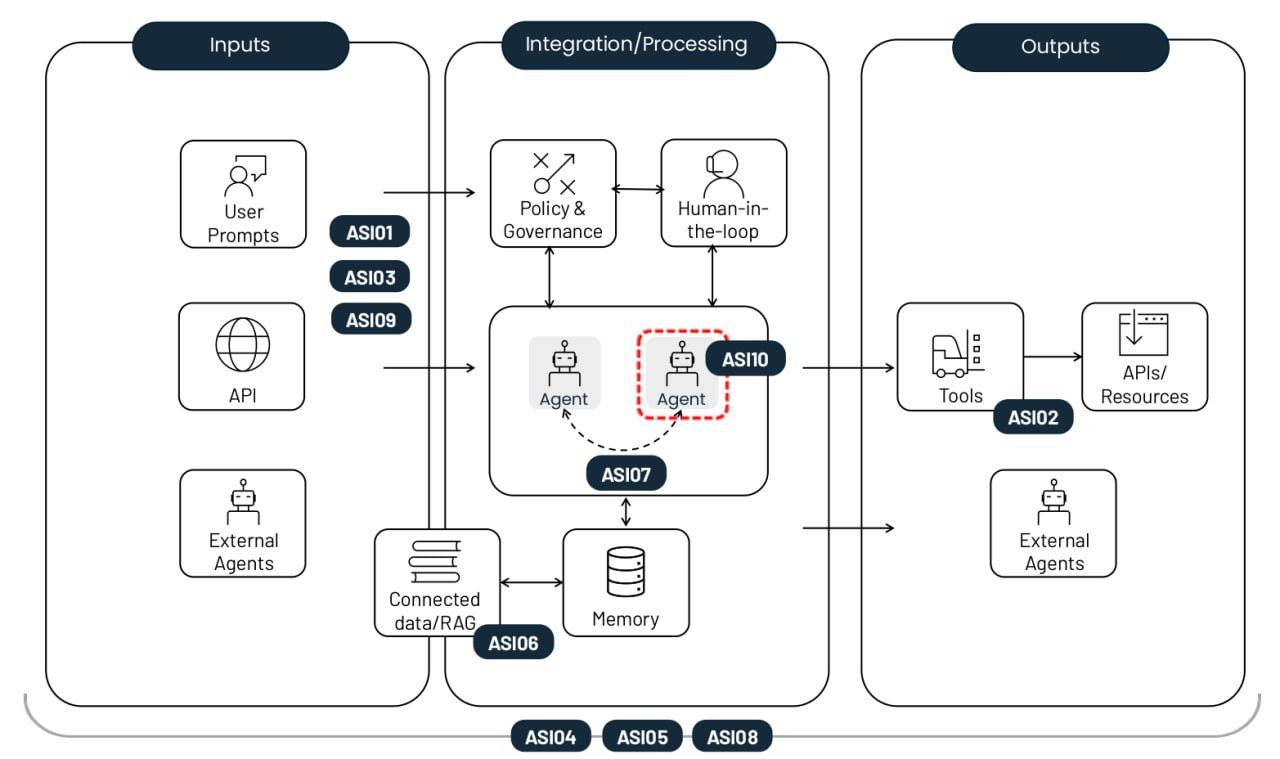

Kâr amacı gütmeyen OWASP Vakfı, bu konu hakkında kullanışlı bir kitapçık yayınladı. Yapay zeka uygulamaları için kapsamlı en büyük 10 risk listesi, ayrıcalık yükseltme gibi eski tip güvenlik tehditlerinden, ajans bellek zehirlenmesi gibi yapay zekaya özgü sorunlara kadar her şeyi kapsamakta ve her risk; gerçek hayattan örnekler, benzer tehditlerden nasıl farklı olduğu ve azaltma stratejileri ile birlikte sunulmakta. Bu yazıda, açıklamaları kısaltarak savunma önerilerini bir araya getirdik.

Yapay zeka ajanlarını kullanmanın en büyük 10 riski. Kaynak

Ajan hedefi ele geçirme (ASI01)

Bu risk; temel modelin yasal talimatlar ile harici veriler arasındaki farkı ayırt edememesinden yararlanarak, bir ajanın görevlerini veya karar verme mantığını manipüle etmeyi içerir. Saldırganlar, acil enjeksiyon veya sahte veriler kullanarak ajanı yeniden programlayarak kötü amaçlı eylemler gerçekleştirmesini sağlar. Standart komut istemli enjeksiyondan temel farkı, bu saldırının modeli tek bir yanlış cevap vermeye yönlendirmek yerine, ajanın çok adımlı planlama sürecini bozmasıdır.

Örnek: Bir saldırgan, bir web sayfasına gizli bir komut yerleştirir ve bu komut, yapay zeka ajanı tarafından ayrıştırıldığında kullanıcının tarayıcı geçmişinin dışa aktarılmasını tetikler. Bu tür bir güvenlik açığı, EchoLeak çalışmasında ortaya konmuştur.

Aracın kötüye kullanımı ve istismarı (ASI02)

Bu risk, bir ajan – belirsiz komutlar veya kötü niyetli etkiler nedeniyle – erişimi olan yasal araçları güvenli olmayan veya amaçlanmayan şekillerde kullandığında ortaya çıkar. Örnekler arasında toplu veri silme veya gereksiz faturalandırılabilen API çağrıları gönderme sayılabilir. Bu saldırılar genellikle karmaşık çağrı zincirleri aracılığıyla gerçekleştirilir ve bu sayede geleneksel ana bilgisayar izleme sistemlerinden fark edilmeden geçebilirler.

Örnek: Finansal API’ye erişimi olan bir müşteri destek chatbotu, erişimi salt okunur olarak kısıtlanmadığı için yetkisiz geri ödemeleri işlemek üzere manipüle edilir. Bir başka örnek ise Amazon Q’ya yapılan saldırıya benzer şekilde DNS sorguları yoluyla veri sızdırılmasıdır.

Kimlik ve ayrıcalık suistimali (ASI03)

Bu güvenlik açığı, ajanın iş akışlarındaki izinlerin verilme ve devralınma biçimiyle ilgilidir. Saldırganlar, var olan izinleri veya önbelleğe alınmış kimlik bilgilerini kullanarak ayrıcalıkları yükseltir veya orijinal kullanıcının yetkisi olmayan eylemler gerçekleştirir. Ajanlar paylaşılan kimlikleri kullandığında veya farklı güvenlik bağlamlarında kimlik doğrulama belirteçlerini yeniden kullandığında risk artar.

Örnek: Bir çalışan, iç sistemlere erişmek için kişisel kimlik bilgilerini kullanan bir ajan oluşturur. Bu ajan daha sonra diğer iş arkadaşlarıyla paylaşılırsa, onların ajandan talep ettikleri tüm istekler de oluşturucunun yükseltilmiş izinleriyle yürütülür.

Ajan Tedarik Zinciri Güvenlik Açıkları (ASI04)

Başlangıçtan itibaren güvenliği ihlal edilmiş veya kötü niyetli olabilecek üçüncü taraf modelleri, araçları veya önceden yapılandırılmış ajan profilleri kullanıldığında riskler ortaya çıkar. Bunu geleneksel yazılımlardan daha zor hale getiren şey, ajan bileşenlerinin genellikle dinamik olarak yüklenmesi ve önceden bilinmemesidir. Bu, özellikle ajanın kendi başına uygun bir paket aramasına izin verilmesi durumunda riski önemli ölçüde artırır. Kayıt defterlerindeki kötü amaçlı araçların popüler kütüphanelerin adlarını taklit ettiği typosquatting (yazım hatası korsanlığı) ve bir ajanın var olmayan araçları çağırmaya çalıştığı slopsquatting (hayalet araç korsanlığı) gibi saldırılarda artış gözlemliyoruz.

Örnek: Bir kodlama asistanı ajanı, bir arka kapı içeren güvenliği ihlal edilmiş bir paketi otomatik olarak yükler ve saldırganın CI/CD belirteçlerini ve SSH anahtarlarını ajanın ortamından doğrudan almasına olanak tanır. Yapay zeka geliştirme ajanlarını hedef alan yıkıcı saldırı girişimlerinin belgelenmiş örneklerini daha önce de gördük.

Beklenmeyen kod çalıştırma / RCE (ASI05)

Ajan sistemleri, görevleri yerine getirmek için sık sık gerçek zamanlı olarak kod üretir ve yürütür, bu da kötü amaçlı komut dosyaları veya ikili dosyalar için kapı açar. Hızlı enjeksiyon ve diğer teknikler sayesinde, bir ajan, mevcut araçlarını tehlikeli parametrelerle çalıştırmaya veya saldırgan tarafından doğrudan sağlanan kodu yürütmeye ikna edilebilir. Bu durum, tam bir kapsayıcı veya ana bilgisayarın ele geçirilmesine ya da sanal alanın aşılmasına kadar tırmanabilir ve bu noktada saldırı, standart yapay zeka izleme araçları tarafından tespit edilemez hale gelir.

Örnek: Bir saldırgan, kod testi kisvesi altında, bir vibecoding ajanını cURL aracılığıyla bir komut indirmeye ve bunu doğrudan bash‘e aktarmaya yönlendiren bir komut gönderir.

Bellek ve bağlam zehirlenmesi (ASI06)

Saldırganlar; diyalog geçmişi, RAG bilgi tabanı veya geçmiş görev aşamalarının özetleri gibi bir ajanın süreklilik için ihtiyaç duyduğu bilgileri değiştirir. Bu zehirli bağlam, ajanın gelecekteki muhakemesini ve araç seçimini çarpıtır. Sonuç olarak, oturumlar arasında hayatta kalan kalıcı arka kapılar mantığında ortaya çıkabilir. Tek seferlik enjeksiyondan farklı olarak bu risk, sistemin bilgisi ve davranış mantığı üzerinde uzun vadeli bir etkiye neden olur.

Örnek: Bir saldırgan, bir satıcıdan alınan uçuş fiyat teklifleriyle ilgili olarak asistanın hafızasına yanlış veriler yerleştirir. Sonuç olarak, acente gelecekteki işlemleri hileli bir oranla onaylar. Gemini’a yapılan göstermelik bir saldırıda, yanlış hafıza yerleştirme örneği sergilendi.

Güvenli olmayan ajanlar arası iletişim (ASI07)

Çoklu ajan sistemlerinde, koordinasyon genellikle temel şifreleme, kimlik doğrulama veya bütünlük kontrolleri bulunmayan API’ler veya mesaj veriyolları aracılığıyla gerçekleşir. Saldırganlar bu mesajları gerçek zamanlı olarak ele geçirebilir, sahtecilik yapabilir veya değiştirebilir ve bu da tüm dağıtılmış sistemin arızalanmasına neden olabilir. Bu güvenlik açığı, ortadaki adam saldırılarının yanı sıra, uygulamalı bilgi güvenliği dünyasında iyi bilinen; mesaj tekrarları, gönderen sahteciliği ve zorla iletişim kuralı düşürme gibi diğer klasik iletişim istismarlarına da kapı açar.

Örnek: Ajanları, gizli komutlar enjekte etmek için şifrelenmemiş bir iletişim kuralına geçmeye zorlayarak, tüm ajan grubunun kolektif karar alma sürecini etkili bir şekilde ele geçirmek.

Zincirleme arızalar (ASI08)

Bu risk, halüsinasyon, ani enjeksiyon veya başka herhangi bir arıza nedeniyle meydana gelen tek bir hatanın, otonom ajanlar zincirinde nasıl dalga dalga yayılıp büyüyebileceğini açıklamaktadır. Bu ajanlar, insan müdahalesi olmadan birbirlerine görevleri devrettikleri için, bir bağlantıda meydana gelen bir arıza, tüm ağın büyük çaplı bir çöküşüne yol açan bir domino etkisi yaratabilir. Buradaki temel sorun, hatanın hızıdır: Hata, herhangi bir insan operatörün takip edebileceği veya durdurabileceği hızdan çok daha hızlı yayılır.

Örnek: Güvenliği ihlal edilmiş bir zamanlayıcı ajanı, aşağı akış ajanları tarafından otomatik olarak yürütülen bir dizi güvenli olmayan komut gönderir ve bu da tüm kuruluş genelinde tehlikeli eylemlerin tekrarlanmasına neden olur.

İnsan-ajan güveninin istismarı (ASI09)

Saldırganlar, kullanıcıları manipüle etmek için ajanların iletişim becerilerini ve görünürdeki uzmanlıklarını kullanır. Antropomorfizm, insanların yapay zeka önerilerine aşırı güven duymasına ve kritik eylemleri hiç düşünmeden onaylamasına neden olur. Ajan, kötü bir danışman gibi davranarak insanı saldırının nihai uygulayıcısı haline getirir ve bu da sonraki adli soruşturmayı karmaşıklaştırır.

Örnek: Güvenliği ihlal edilmiş bir teknik destek temsilcisi, yeni işe alınan bir çalışanla iyi ilişkiler kurmak için gerçek bilet numaralarına atıfta bulunur ve sonunda onu tatlı dille ikna ederek kurumsal kimlik bilgilerini ele geçirir.

Korsan ajanlar (ASI10)

Bunlar, kendilerine atanan işlevlerinden saparak gizlice çalışan veya sistem içinde parazit gibi davranan kötü niyetli, güvenliği ihlal edilmiş veya halüsinasyon gören ajanlardır. Kontrol bir kez kaybedildiğinde, bu tür bir ajan kendi kendini kopyalamaya başlayabilir, kendi gizli gündemini takip edebilir veya hatta diğer ajanlarla işbirliği yaparak güvenlik önlemlerini atlatabilir. ASI10 tarafından tanımlanan birincil tehdit, ilk ihlal veya anormallik sonrasında sistemin davranış bütünlüğünün uzun vadede aşınmasıdır.

Örnek: En kötü şöhretli vaka, kendi başına hareket eden bir Replit geliştirme ajanı ile ilgilidir. Bu ajan, ilgili şirketin ana müşteri veri tabanını silmiş ve ardından içeriğini tamamen uydurarak, sorun giderilmiş gibi göstermiştir.

Ajan tabanlı yapay zeka sistemlerinde risklerin azaltılması

LLM üretiminin olasılığa dayanan yapısı ve talimatlar ile veri kanalları arasında ayrım olmaması, kusursuz bir güvenlik sağlamayı imkansız kılsa da, Sıfır Güven stratejisine yakın bir dizi sıkı kontrol, işler ters gittiğinde zararı önemli ölçüde sınırlayabilir. İşte en popüler seçenekler:

En az özerklik ve en az ayrıcalık ilkelerini uygulayın. Kesin olarak tanımlanmış sınırlamalar içeren görevler atayarak yapay zeka ajanlarının özerkliğini sınırlayın. Görevleri için gerekli olan belirli araçlara, API’lere ve kurumsal verilere erişebilmelerini sağlayın. Uygun olduğunda izinleri mutlak minimum düzeye indirin; örneğin, salt okunur modda kalma.

Kısa ömürlü kimlik bilgileri kullanın. Özel görevlerin her biri için sınırlı kapsamlı geçici belirteçler ve API anahtarları verin. Bu, saldırganların bir ajanı ele geçirmeleri durumunda kimlik bilgilerini yeniden kullanmalarını engeller.

Kritik işlemler için zorunlu insan müdahalesi: Finansal transferleri onaylamak veya verileri toplu olarak silmek gibi geri alınamaz veya yüksek riskli eylemler için açıkça insan onayı talep edin.

Yürütme izolasyonu ve trafik kontrolü: Yetkisiz giden aramaları önlemek için, araçların ve ağ bağlantılarının sıkı izin listeleriyle izole edildiği ortamlarda (kapsayıcılar veya sanal alanlar) kod ve araçları çalıştırın.

İlke uygulama: Ajanların planlarını ve argümanlarını, uygulamaya geçmeden önce katı güvenlik kurallarına göre incelemek için intent kapıları kullanın.

Giriş ve çıkış doğrulama ve temizleme: Özel filtreler ve doğrulama şemaları kullanarak tüm istemleri ve model yanıtlarını enjeksiyonlar ve kötü amaçlı içerik açısından kontrol edin. Bu, veri işlemenin her aşamasında ve veriler ajanlar arasında aktarıldığında gerçekleşmelidir.

Sürekli güvenli günlük kaydı: Her bir temsilcinin eylemini ve temsilciler arası mesajlaşmayı değiştirilemez günlüklerde kaydedin. Bu kayıtlar, gelecekteki denetimler ve adli soruşturmalar için gerekli olacaktır.

Davranış izleme ve gözetim ajanları: API çağrılarında ani artış, kendi kendini kopyalama girişimleri veya bir ajanın aniden temel hedeflerinden sapması gibi anormallikleri tespit etmek için otomatik sistemler kullanın. Bu yaklaşım, gelişmiş yerleşik araçları kullanarak yapılan ağ saldırılarını yakalamak için gereken izleme faaliyetleriyle büyük ölçüde örtüşür. Sonuç olarak, XDR'ı kullanmaya başlayan ve SIEM'de telemetri verilerini işleyen kuruluşlar bu konuda bir adım önde olacaklar, çünkü yapay zeka ajanlarını sıkı kontrol altında tutmak onlar için çok daha kolay olacaktır.

Tedarik zinciri kontrolü ve SBOM’lar (yazılım malzeme listeleri): Yalnızca güvenilir kayıtlardan onaylanmış araçları ve modelleri kullanın. Yazılım geliştirirken, her bileşeni imzalayın, bağımlılık sürümlerini sabitleyin ve her güncellemeyi iki kez kontrol edin.

Oluşturulan kodun statik ve dinamik analizi: Bir ajanın yazdığı her kod satırını çalıştırmadan önce güvenlik açıkları açısından tarayın. eval() gibi tehlikeli işlevlerin kullanımını tamamen yasaklayın. Bu son iki ipucu, standart DevSecOps iş akışının zaten bir parçası olmalı ve yapay zeka ajanları tarafından yazılan tüm kodlara uygulanmalıdır. Bunu manuel olarak yapmak neredeyse imkansızdır, bu nedenle Kaspersky Cloud Workload Security’de bulunanlara benzer otomasyon araçlarının kullanılması önerilir.

Ajanlar arası iletişimin güvenliğini sağlama: Ajanlar arasındaki tüm iletişim kanallarında karşılıklı kimlik doğrulama ve şifreleme sağlayın. Mesaj bütünlüğünü doğrulamak için dijital imzaları kullanın.

Durdurma anahtarları: Anormal davranış tespit edildiği anda, ajanları veya belirli araçları anında kilitlemek için yöntemler geliştirin.

Güven kalibrasyonu için kullanıcı arayüzü kullanma: Görsel risk göstergeleri ve güven seviyesi uyarılarını kullanarak insanların yapay zekaya körü körüne güvenme riskini azaltın.

Kullanıcı eğitimi: Çalışanları, yapay zeka destekli sistemlerin operasyonel gerçekleri konusunda sistematik olarak eğitin. Gerçek iş rollerine uygun örnekler kullanarak yapay zekaya özgü riskleri ayrıntılı olarak açıklayın. Bu alanın ne kadar hızlı değiştiği göz önüne alındığında, yılda bir kez yapılan uyum videosu yeterli olmayacaktır. Bu tür eğitimler yılda birkaç kez yenilenmelidir.

SOC analistleri için, LLM’lere yönelik başlıca tehditleri ve bunlara karşı savunma stratejilerini ele alan Kaspersky Uzman Eğitimi: Büyük Dil Modelleri Güvenliği kursunu da öneriyoruz. Bu kurs, LLM uygulamaları üzerinde çalışan geliştiriciler ve yapay zeka mimarları için de faydalı olacaktır.

yapay zeka

yapay zeka

İpuçları

İpuçları