AI ajanları etkileyici demoların ötesine geçip sizin adınıza gerçekten işlem yapabilen araçlara doğru hızla ilerliyor ve OpenClaw, bu ilginin son dalgasına öncülük eden isimlerden biri. Avusturyalı geliştirici Peter Steinberger tarafından geliştirilen yazılımın farklı geliştirme aşamalarında Clawdbot ve Moltbot adlarıyla anıldığını duymuş olabilirsiniz.

Kullanıcının müdahalesi olmadan yazılımlar çalıştırabilen bir kişisel asistan olarak tanıtılsa da erişim ve güvenlik konusunda önemli soruları da beraberinde getiriyor.

- AI ajanları yalnızca konuşma tabanlı değil, eylem gerçekleştirebilen yapay zeka sistemleridir.

- OpenClaw gibi araçlar, kendi sunucunuzda barındırdığınız AI ajanlarının ne kadar güçlü olabileceğini gösteriyor.

- Bu güç, ajanlar güvensiz girdi işlediğinde yeni güvenlik riskleri doğuruyor.

- Komut enjeksiyonu, AI ajanları için sohbet botlarına göre daha büyük bir tehdittir.

- Kalıcı bellek hataları büyütebilir ve saldırıları uzatabilir.

- AI ajanları güçlüdür, ancak çoğu tüketici için varsayılan olarak güvenli bir seçenek değildir.

OpenClaw hakkında neden bu kadar konuşuluyor?

OpenClaw dikkat çekiyor çünkü sorulara yanıt veren AI'ten gerçek sistemlerde görevleri aktif olarak yerine getirebilen ve hatta yazılım kullanabilen AI ajanlarına doğru bir kaymayı temsil ediyor. Olası güvenlik sorunları nedeniyle de güvenlik çevrelerinde daha fazla tartışma konusu oldu. Peki OpenClaw geliştiriciler ve ileri düzey kullanıcılar için neden çekici?

OpenClaw, yalnızca metin veya öneri üretmekle kalmayıp gerçek eylemler gerçekleştirebilmesiyle öne çıkıyor. Size ne yapılması gerektiğini söylemek yerine işleri kendisi yapabiliyor. Teknoloji uygulamaları açabilir, mesaj gönderebilir, dosya taşıyabilir, komut çalıştırabilir ve sistemlerle doğrudan etkileşime girebilir.

Bu düzeyde otomasyon ilgi çekiyor. Geliştiriciler ve ileri düzey kullanıcılar, tekrarlayan işleri azaltmak veya iş akışlarını otomatikleştirmek için sistem düzeyinde kontrolü bir fırsat olarak görüyor. Kenardan yardımcı olmak yerine “işi yapan” bir AI ajanı fikri güçlü bir konsept.

Bu uygulamalı yetenek vaadi, OpenClaw'ın niş bir projeden daha geniş tartışmalara hızla taşınmasının nedenlerinden biri.

OpenClaw ötesinde bunun önemi nedir

OpenClaw, yalnızca yanıt verip tavsiye veren değil, gerçekten eylemde bulunan AI ajanlarına doğru daha geniş bir kaymanın görünür bir örneğini sunuyor.

Bu tür bir teknoloji büyüdükçe kötüye kullanım olasılığı kaçınılmaz bir tartışma konusu haline geliyor. OpenClaw'ın gösterdiği şey AI'in nereye gittiği ve bu, tek bir projeyi aşan bir önem taşıyor; ajanların nasıl denetleneceğine dair sürekli tartışmaların zeminini hazırlıyor. Onlara güvenebilir miyiz?

AI ajanları nedir ve diğer AI araçlardan farkı ne?

AI ajanları sadece sorularınıza metin ya da sesle yanıt vermekle kalmaz. Bir hedefe ulaşmak için adımlar planlayabilir ve bu adımları uygulayarak eylem gerçekleştirebilir. Tavsiyeyle sınırlanmak yerine ne yapılacağına karar verir ve uygulamaya koyar.

Bir AI ajanı durumu gözlemleyip eyleme geçebilir. Bu, çoğu AI aracından farklıdır; çünkü sıradan araçlar komutlara yanıt verir ve bir sonraki talimatı bekler. Erken örnekler arasında Manus gibi görev çalıştıran ajanlar (şimdi Meta çatısı altında) bulunuyor. Manus, ajanların sohbetin ötesine geçip eyleme nasıl geçebileceğini gösteriyor; veri analizi yapabilir veya sorunları çözmek için doğrudan kod yazabilir, bunun için her seferinde açıkça ne yapılacağını sormaya gerek kalmayabilir. İnsan girdisi daha azdır.

OpenClaw da bu eylem gerçekleştirebilen AI fikrini temel alıyor, ancak bunu daha doğrudan ve güçlü bir şekilde uyguluyor.

OpenClaw tipik bir AI ajanı mı yoksa daha gelişmiş mi?

OpenClaw, AI ajanları kategorisine girer. Birçok kişinin aşina olduğu araçlardan daha güçlü bir uygulama sunuyor.

Bu AI aracı, sürekli girdi gerektirmeden görev planlayıp hareket edebilir. OpenClaw, yalnızca API'lerle veya sınırlı araçlarla etkileşimle kalmayıp doğrudan yazılımlar ve işletim sistemiyle etkileşime girebilir. Bu geniş erişim faydayı artırırken güvenlik açısından da riskleri yükseltir.

Kendi sunucunuzda çalışan AI ajanlar neden farklı?

Kendi sunucunuzda çalışan AI ajanlar uzak bir hizmette değil, doğrudan sizin sisteminizde çalışır. Bu, yapılandırma ve davranış üzerinde kullanıcılara daha fazla kontrol verir; ancak aynı zamanda sorumluluğu da kullanıcıya kaydırır.

Bir ajanın yerel erişimi olduğunda güvenlik, nasıl yapılandırıldığına, hangi izinlere sahip olduğuna ve nasıl izlenip denetlendiğine bağlıdır. Daha fazla kontrol daha fazla risk anlamına gelebilir.

Son projeler, kendi sunucunuzda çalışan ajan kavramının nasıl değiştiğini gösteriyor. Örneğin Moltbot (eski adıyla Clawdbot) artık Cloudflare’ın açık kaynaklı Moltworker’ı kullanılarak çalıştırılabiliyor. Bu, ajanın çalışması için özel yerel donanıma ihtiyaç duyulmasını tamamen ortadan kaldırıp yönetilen platformda çalıştırılmasını sağlıyor.

Bu durum giriş engelini düşürüyor ve kurulumu kolaylaştırıyor, fakat kontrolün nerede bulunduğunu da değiştiriyor. Bir ajan bulut altyapısında çalıştığında güvenlik yalnızca ajanın kendisine bağlı değil; erişim kontrolleri ve platform çapında veri ile izinlerin nasıl yönetildiğine de bağlı hale geliyor.

Örneğin bir kullanıcı, ajanın yalnızca e-postaları okumasını beklerken, bulut kurulumu aynı zamanda açıkça kapatılmadıkça e-posta göndermesine izin verebilir.

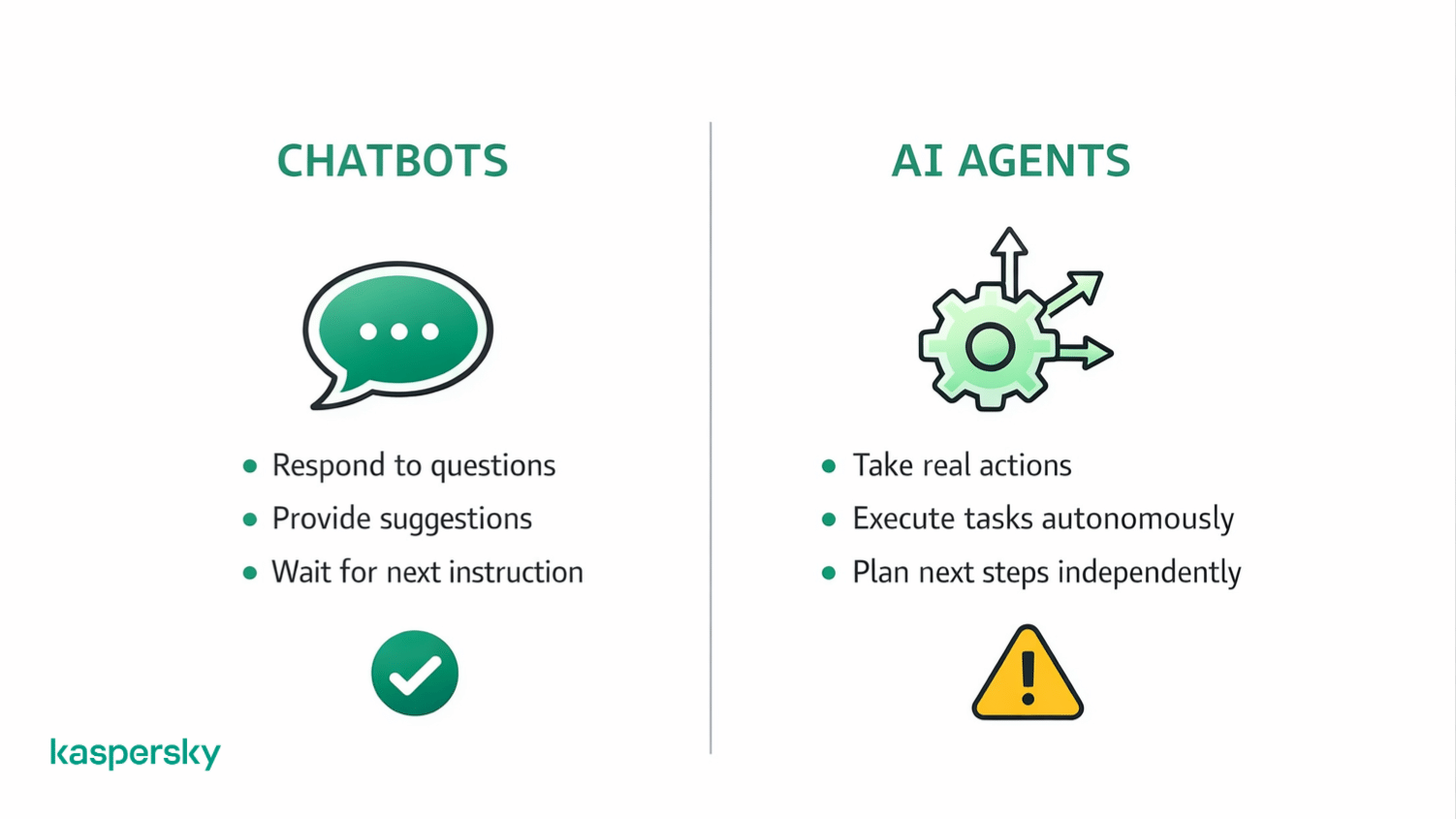

AI ajanları ChatGPT gibi sohbet botlarından nasıl farklı?

Sohbet botları (ör. ChatGPT) yanıt verirken, AI ajanları eylemde bulunur.

Bir sohbet botu size öneriler veya açıklamalar sunabilir. Bir AI ajanı ise programları açabilir veya iş akışlarını bizzat yürütebilir.

Örneğin bazı kişiler OpenClaw'ı ticareti otomatikleştirmek için kullanmış. Kurallar oluşturmuşlar ve AI'ten yalnızca tavsiye vermesini değil (bunu ChatGPT de yapabilirdi) gerçek işlemleri yerine getirmesini istemişler.

AI ajanları neden yeni güvenlik riskleri getiriyor?

Daha önce tartışıldığı gibi, AI ajanları sadece tavsiye vermek yerine eylemde bulunur. Bu genellikle dosyalara, uygulamalara veya sistem fonksiyonlarına erişim demektir.

OpenClaw’a verilen sistem erişimi ve özerklik hem etkiyi hem de riski artırır. OpenClaw, yazılımlarla etkileşimde bulunmak veya e-posta göndermek ya da formları doldurmak gibi gözetimsiz eylemler gerçekleştirebilir. Bu da onu öngörülemez hale getirebilir.

Hatalar veya manipülasyonun sonuçları gerçek olabilir. Risk sadece ajana verilen görevle sınırlı değildir; ajanın bir görevi yerine getirirken neyi talimat olarak algıladığı da önemlidir.

Güvenilmeyen girdinin neden temel bir sorun olduğu

AI ajanları bir sonraki adımı belirlemek için web sayfaları ve belgeler gibi büyük miktarda dış içerik tüketir. Bu içerik her zaman güvenilir değildir.

Talimatlar doğrudan olmak zorunda değildir. Ajanın bir görev sırasında okuduğu metin veya verinin içine gizlenmiş olabilir. Bu, saldırganların ajanla doğrudan etkileşime geçmeden davranışını etkilemesini mümkün kılar.

Bu durum açık bir yol sunar: komut enjeksiyonu. Güvenilmeyen girdinin ajanın, amaçlanmayan eylemleri gerçekleştirmesi için yönlendirilmesinde kullanılmasıdır.

Güçlü AI araçlar daha sıkı korunma gerektirir

AI ajanları dosyalara, e-postalara ve sistem fonksiyonlarına erişebilir. Kaspersky Premium şüpheli etkinlikleri tespit etmeye, kötü amaçlı betikleri engellemeye ve cihazlarınızı gerçek dünyadaki siber tehditlere karşı korumaya yardımcı olur.

Kaspersky Premium'u Deneyin (Ücretsiz)AI ajanlarında komut enjeksiyonu nedir?

Komut enjeksiyonu, bir AI ajanının davranışını değiştirecek güvensiz içerikle manipüle etme yöntemidir.

Risk teknik bir kod hatasından ziyade, ajanın dış girdileri anlık mesajlar veya yorumlar gibi talimat olarak algılayabilmesidir. Bu olduğunda ajan, asla yapması amaçlanmamış eylemlere yönlendirilebilir.

Gerçek dünyada komut enjeksiyonu nasıl işler

Komut enjeksiyonu doğrudan veya dolaylı olabilir.

- Doğrudan – saldırgan, ajanın okuduğu içeriğe kasıtlı olarak talimatlar ekler.

- Dolaylı – ajan normal görevleri sırasında işlediği bir web sitesi veya mesajdan gizli veya beklenmedik talimatlar alır.

Ana mesele davranıştır. Ajan, kaynağı güvenilir olmasa bile algıladığı rehberliği izleyebilir. Bunun gerçekleşmesi için klasik bir yazılım hatası gerekmez.

Komut enjeksiyonu neden AI ajanları için sohbet botlarından daha tehlikelidir

Enjekte edilen talimatlar genellikle sohbet botlarının verdiği yanıtları ve önerileri etkiler. AI ajanlarında ise bu talimatlar doğrudan eylemleri etkileyebilir.

Bir ajanın dosyalara veya sistem kontrollerine erişimi varsa, manipüle edilmiş talimatlar gerçek dünyada değişikliklere yol açabilir. Bu yüzden komut enjeksiyonu, ajanlar için daha büyük bir risk oluşturur. Sohbet botlarında metin çıktısını değiştiren aynı teknik, ajan devredeyken istenmeyen eylemleri tetikleyebilir.

AI ajanlarında kalıcı bellek nedir?

Kalıcı bellek, bir AI ajanının zaman içinde bilgiyi saklamasına olanak tanır. Bu, her görevde temiz bir sayfadan başlamayıp önceki girdileri gelecekteki kararları yönlendirmek için kullanabileceği anlamına gelir.

Kalıcı belleğin AI ajanları için anlamı

Bir AI ajanı, oturumlar arasında bağlamı ve talimatları saklayabilir ve tercih edilen “davranışlar” geliştirebilir. Bu, ajanın daha önce öğrendiklerini veya yaptığı işleri hatırlayarak daha verimli çalışmasına yardımcı olur.

Aynı zamanda önceki girdilerin sonraki davranışı etkileyebileceği anlamına gelir. Önceki bir görev sırasında edinilen talimatlar veya varsayımlar, kullanıcı artık farkında olmasa bile farklı bir durumda ajanın davranışını şekillendirmeye devam edebilir.

Kalıcı bellek güvenlik risklerini neden artırır

Kalıcı bellek gecikmeli etkilere neden olabilir. Zararlı bir talimat hemen sorun yaratmayabilir, ancak uygun koşullar oluştuğunda daha sonra yeniden gündeme gelebilir.

Bu durum temizlemeyi zorlaştırır. Saklanan davranış görevler arasında tekrarlanabilir. Bir ajanı tamamen eski haline getirmek genellikle belleği temizlemeyi veya yapılandırmaları yeniden oluşturarak istenmeyen etkinin kaldırıldığından emin olmayı gerektirir.

Bir AI ajanı yanlış yapılandırıldığında veya açığa çıktığında ne olur?

Bir AI ajanı, sahibi hiç istemediği şekillerde erişilebilir veya etkilenebilir hale gelebilir; bu da faydalı bir aracın potansiyel bir güvenlik riskine dönüşmesine yol açar.

Bu bir kaza veya yanlış anlamadan kaynaklanabilir. Üçüncü tarafların ajanı manipüle etmeye çalışmasıyla da olabilir.

AI ajanları istemeden nasıl açığa çıkabilir

Açığa çıkma genellikle basit hatalarla olur. Zayıf kimlik doğrulama veya aşırı geniş izinler gibi basit bir şey, ajanı hedeflenen ortamının dışından erişilebilir kılabilir.

Bir ajanı yerelde çalıştırmak otomatik olarak onu güvenli yapmaz. İnternete bağlanır veya diğer sistemlerle etkileşime girerse etkilenebilir. Yerel kontrol bazı riskleri azaltır ama ortadan kaldırmaz.

Açığa çıkan AI ajanları neden saldırı yüzeyine dönüşür

Açığa çıktıktan sonra bir AI ajanı, saldırganların üzerinde inceleme, test ve manipülasyon yapabileceği bir hedef hâline gelir. Saldırganlar ona özel olarak hazırlanmış girdiler vererek eylemleri tetiklemeye veya zaman içinde davranışını öğrenmeye çalışabilir.

Ajanlar gerçek eylemler gerçekleştirebildiği için kötüye kullanım klasik bir hack şeklinde olmak zorunda değildir. Kötüye kullanım, davranışı yönlendirme, veri çıkarma veya sistemde istenmeyen değişikliklere yol açma şeklinde olabilir; bunun için klasik bir yazılım açığından faydalanmak şart değildir.

AI ajan güvenliğinde “ölümcül üçlü” nedir?

“Ölümcül üçlü”, birlikte ciddi güvenlik riski yaratan üç koşulu tanımlar.

Ciddi saldırılara yol açan üç koşul

- Birinci koşul, dosyalar, kimlik bilgileri veya dahili bilgiler gibi hassas verilere erişimdir.

- İkinci koşul, ajanın tamamen doğrulayamadığı güvensiz girdiler tüketmesidir.

- Üçüncü koşul ise istek gönderme, sistemleri değiştirme veya komut çalıştırma gibi dış eylemler gerçekleştirebilme yeteneğidir.

Tek başına bu faktörler yönetilebilir olabilir. Ancak üçü bir araya geldiğinde tehlikelidir. Güvensiz girdiyi okuyup buna göre hareket edebilen ve eylem yapabilen bir ajan, manipülasyon için açık bir yol oluşturur. Ajanın hangi eylemleri gerçekleştirmesine izin verildiğini denetlemek hayati önemdedir.

Günlük kullanıcılar bugün AI ajanları çalıştırmalı mı?

Çoğu insan için AI ajanları hâlâ deneysel araçlardır. Doğru kurulumda faydalı olabilirler. Dezavantajı ise görünmeyen yeni riskler getirmeleridir.

AI ajanı kullanmanın anlamlı olduğu durumlar

AI ajanı, kontrol altında ve düşük riskli senaryolarda mantıklı olabilir. Bu, ayrı bir cihazda denemeler yapmak gibi uygulamaları içerir. Bazıları yalnızca hassas olmayan görevleri — dosyaları düzenlemek veya iş akışlarını test etmek gibi — üstlenen ajanları çalıştırmayı dener.

Örneğin ajanın yaklaşan seyahatiniz için bir gezi programı oluşturmasını istiyorsunuz. Bu durumda gerekli bilgilere erişip doğrudan başkalarıyla iletişime geçmesine veya zarar verebilecek işlemler yapmasına izin verilmemesi sağlanabilir.

Ayarları yönetebileceğinizden eminseniz ve yapılacak hataların yüksek riskli sonuçları yoksa ajan öğrenme aracı olarak kullanılabilir. Kilit nokta kapsamı küçük tutmak ve erişimleri sıkı şekilde sınırlamaktır.

AI ajanlarının kötü bir fikir olduğu durumlar

AI ajanları, hassas verilere veya önemli hesaplara erişimi olduğunda uygun değildir. İzinleri veya dış girdilerin tehlikelerini anlamadan ajan çalıştırmak riski hızla artırır.

Ayrıca vazgeçmek de makul bir tercihtir. Güvenlik veya iç huzur pahasına kolaylık sağlanıyorsa bugün bir AI ajanı çalıştırmamayı seçmek mantıklı bir karar olabilir.

AI ajanları kullanırken hangi temel korumalar gereklidir?

Temel korumalar riski azaltmaya ve hataların ciddi problemlere dönüşmesini önlemeye yardımcı olur.

Kaspersky yazılımları, şüpheli davranışları işaretleyerek ve hesap ihlallerine karşı ek koruma sağlayarak ekstra bir savunma katmanı ekleyebilir. Planlarımız, kötü amaçlı yazılımlar ve virüslerden fidye yazılımlarına ve casus uygulamalara kadar birçok tehdidi engeller.

Hangi güvenlik önlemleri en önemli

İzolasyon çok önemlidir. Mümkün olduğunda ajanları ayrı cihazlarda ve hesaplarda çalıştırın ki önemli veriler veya sistemler etkilenmesin. İzinleri ajanın gerçekten ihtiyaç duyduğu ile sınırlayın. Varsayılan olarak tam sistem veya hesap erişimi vermekten kaçınmanızı öneririz.

Onay adımları da önemlidir. Hassas işlemlerden önce onay gerektirmek, örneğin sizin adınıza para harcama gibi istenmeyen davranışları engelleyen bir duraklama sağlar. Bu basit kontroller, büyük karmaşıklık eklemeden yüksek etki sunar.

AI ajanları tüketici yapay zekasının (AI) geleceği için ne anlama geliyor?

AI ajanları, AI araçlarının yalnızca yardımcı olmaktan öte eyleme geçeceği bir geleceğe işaret ediyor. Ancak bu kayma, tüketicilerin henüz tam anlamıyla yolunu bulmaya başladığı ödünleri beraberinde getiriyor.

Bu dönem AI ajanlarının olgunluğu hakkında bize ne söylüyor

AI ajanları güçlü ama olgunlaşmamış durumda. Görevleri otomatikleştirebilirler, ancak hâlâ yargı ve güvenlik gerektiren bazı konularda zorlanıyorlar. Bu, ajanların daha güvenli veya daha güvenilir olmayacağı anlamına gelmez; beklentilerin gerçekçi tutulması gerektiğini gösterir.

AI ajanları nereye gidildiğini gösteriyor, fakat yaygın ve günlük kullanım daha iyi korumalar ve baştan güvenlik düşünülerek tasarlanmış araçlar gerektirecek.

İlgili makaleler:

- ChatGPT siber güvenlik endişelerini ve olası riskleri nasıl ele alıyor?

- Günümüz dijital ortamında AI kaynaklı siber suç riskleri nelerdir?

- AI ve Makine Öğrenimi siber güvenlik önlemlerini nasıl güçlendirir?

- Günümüzde Deepfake teknolojisinin tehlikeleri nelerdir?

Önerilen ürünler:

FAQs

OpenClaw ücretsiz indirilebilir mi?

OpenClaw Github üzerinden ücretsiz indirilebilir. Açık kaynak (Open Source) bir yazılımdır. Bu, yazılımın değiştirilip yeniden dağıtılmasına daha fazla olanak tanır.

OpenClaw kurulumu kolay mı?

Bazı öğretici rehberler botları hızlıca çalıştırmaya yardımcı olur, ancak gelişmiş bir kurulum zaman ve uzmanlık gerektirir. Bu nedenle, düzgün yapılandırılmamış yazılımları çalıştırmak daha riskli olabilir.