Siber Güvenlikte Yapay Zeka ve Makine Öğrenimi

Yapay zeka alanında bir öncü olan Arthur Samuel, yapay zekayı "bilgisayarlara açık bir şekilde programlanmadan öğrenme yeteneği kazandıran" bir dizi yöntem ve teknoloji olarak tanımlamıştır. Kötü amaçlı yazılımdan korumaya yönelik denetimli öğrenme durumunda, görev şu şekilde formüle edilebilir: Girdi olarak bir dizi nesne özelliği \( X \) ve ilgili nesne etiketleri \( Y \) verildiğinde, daha önce görülmemiş X test nesneleri için doğru \( Y \) etiketleri üreten bir model oluşturma. Bu durumda \( X \), dosya içeriğini veya davranışını temsil eden birtakım özellikler olabilir (dosya istatistikleri, kullanılan API işlevlerinin listesi vb.). \( Y \) etiketleri ise basitçe "kötü amaçlı" veya "iyi amaçlı" olabilir (daha karmaşık durumlarda Virüs, Trojan İndirici, Reklam Yazılımı gibi daha spesifik sınıflandırma kullanılabilir). Denetimsiz öğrenme, daha çok gizli veri yapılarını ortaya çıkarmakla ilgilidir (ör. benzer nesne gruplarını veya yüksek oranda ilişkili özellikleri bulma).

Kaspersky'nin çok katmanlı, yeni nesil koruması, gelen dosya akışlarını önceden işlemek için kullanılan ölçeklenebilir kümeleme yöntemlerinden, doğrudan kullanıcıların makinelerinde çalışan davranışsal tespit için sağlam ve kompakt derin sinir ağı modellerine kadar, tespit işlem hattının tüm aşamalarında makine öğrenimi gibi yapay zeka yaklaşımlarını kapsamlı bir şekilde kullanır. Bu teknolojiler, gerçek dünyadaki siber güvenlik uygulamaları için son derece düşük bir yanlış pozitif sonuç oranı, modellerin yorumlanabilirliği ve düşmanlara karşı sağlamlık gibi bazı önemli gereksinimleri karşılamak üzere tasarlanmıştır.

Kaspersky'nin uç nokta ürünlerinde kullanılan en önemli makine öğrenimi tabanlı teknolojilerden bazılarını ele alalım:

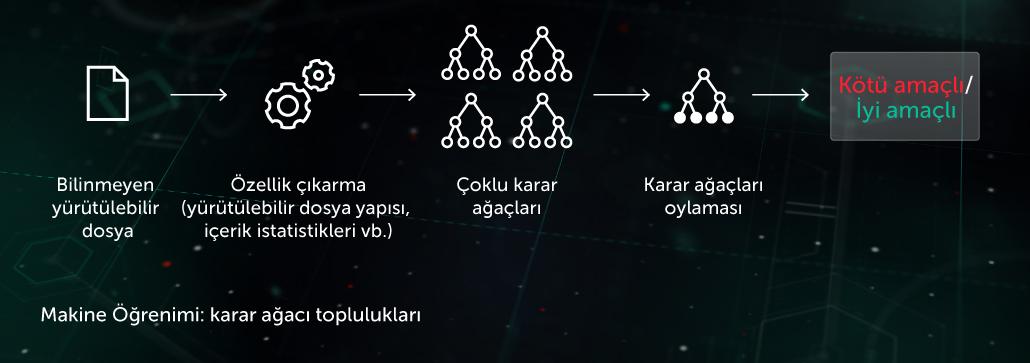

Karar Ağacı Topluluğu

Bu yaklaşımda, kestirimci model bir dizi karar ağacı (ör. rastgele orman veya gradyan artırılmış ağaçlar) biçimini alır. Bir ağaçtaki yaprak olmayan düğümler dosyanın özellikleriyle ilgili bir soru içerirken yaprak düğümler, ağacın nesneyle ilgili son kararını içerir. Test aşamasında model, düğümdeki soruları incelenmekte olan nesnenin ilgili özellikleriyle cevaplayarak ağacı bir yandan öbür yana dolaşır. Son aşamada, nesneyle ilgili son kararı sağlamak için algoritmaya özgü bir şekilde birçok ağacın kararlarının ortalaması alınır.

Model, uç nokta sitesindeki Yürütme Öncesi Proaktif Koruma aşaması için faydalıdır. Bu teknolojiyi kullandığımız uygulamalardan biri mobil tehdit algılaması için kullanılan Cloud ML for Android'dir.

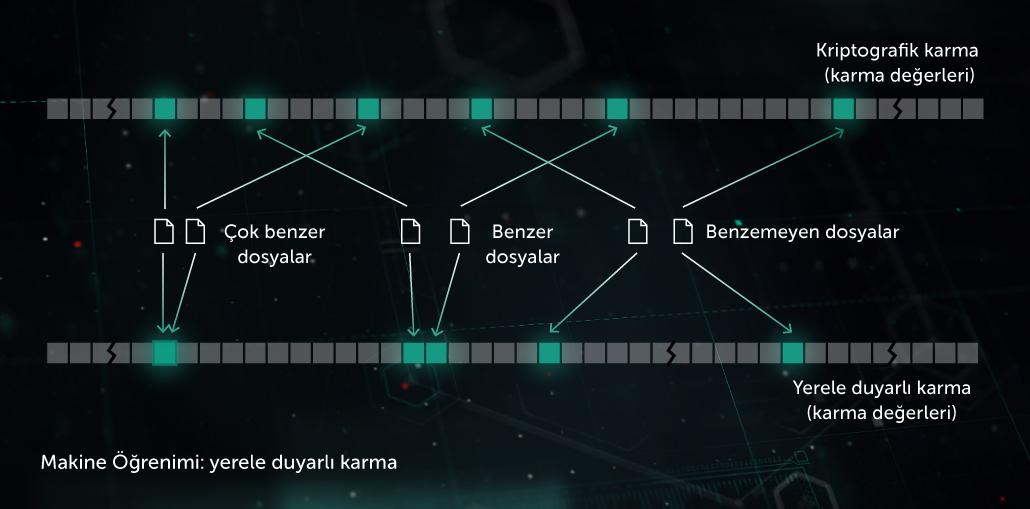

Benzerlik Karması (Yerele Duyarlı Karma)

Geçmişte, kötü amaçlı yazılım “ayak izleri” oluşturmak için kullanılan karmalar bir dosyadaki her küçük değişikliğe duyarlıydı. Bu sorun, kötü amaçlı yazılım yazarları tarafından sunucu tarafında çok biçimlilik gibi gizlenme teknikleriyle kötüye kullanılıyordu: Kötü amaçlı yazılımdaki küçük değişiklikler yazılımın radara yakalanmamasını sağlıyordu. Benzerlik karması (ya da bölgeye duyarlı karma) benzer kötü amaçlı dosyaları algılamaya yönelik bir yapay zeka yöntemidir. Bunu yapmak için sistem, dosya özelliklerini ayıklar ve en önemli özellikleri seçmek için dikey izdüşümlü öğrenme kullanır. Benzer özelliklerin değer vektörlerinin benzer veya aynı şablonlara dönüştürülmesi için ML tabanlı sıkıştırma uygulanır. Bu yöntem iyi seviyede genelleştirme sağlar ve artık tek bir kayıt, çok biçimli kötü amaçlı yazılım ailesinin tamamını algılayabildiği için algılama kayıtları veritabanının boyutunu büyük ölçüde azaltır.

Model, uç nokta sitesindeki Yürütme Öncesi Proaktif Koruma aşaması için faydalıdır. Bu teknoloji, Benzerlik Karması Algılama Sistemi'mizde kullanılır.

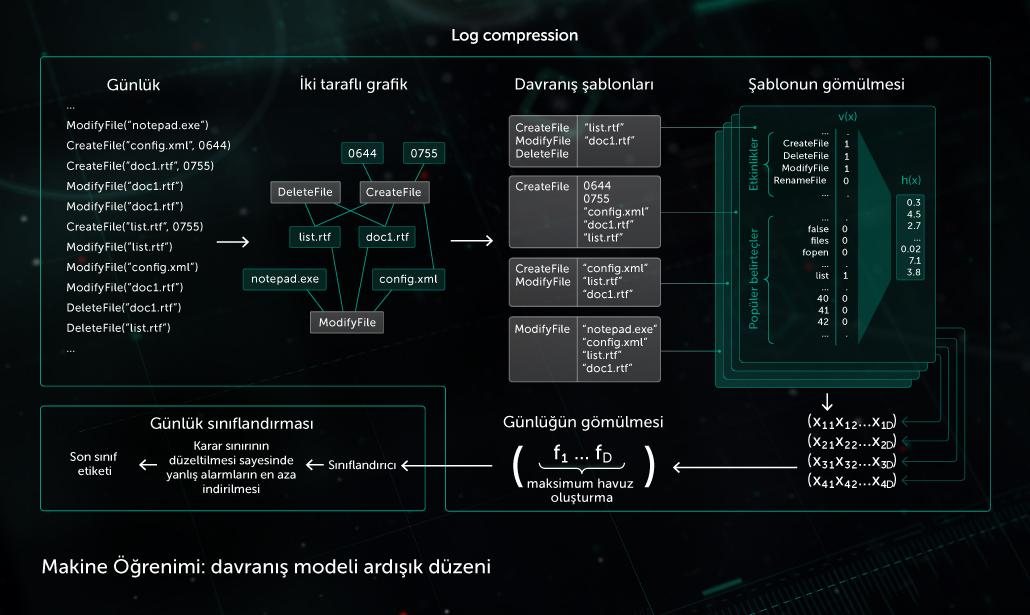

Davranışsal Model

İzleme bileşeni, bir davranış günlüğü (ilgili değişkenlerle birlikte işlemin yürütülmesi sırasında meydana gelen sistem olaylarının listesi) sağlar. Gözlemlenen günlük verilerindeki kötü amaçlı yazılım etkinliklerini algılamak için modelimiz, elde edilen olay listesini sıkıştırarak bir ikili vektör kümesi haline getirir ve derin sinir ağını, temiz ve kötü amaçlı günlükleri ayırt edecek şekilde eğitir.

Davranışsal Model tarafından yapılan nesne sınıflandırması, uç nokta sitesindeki Kaspersky ürünlerinde hem statik hem de dinamik algılama modülleri tarafından kullanılır.

Yapay zeka, uygun laboratuvar içi kötü amaçlı yazılım işleme altyapısının oluşturulmasında da eşit derecede önemli bir rol oynamaktadır. Kaspersky bunu, aşağıdaki altyapı amaçları için kullanıyor:

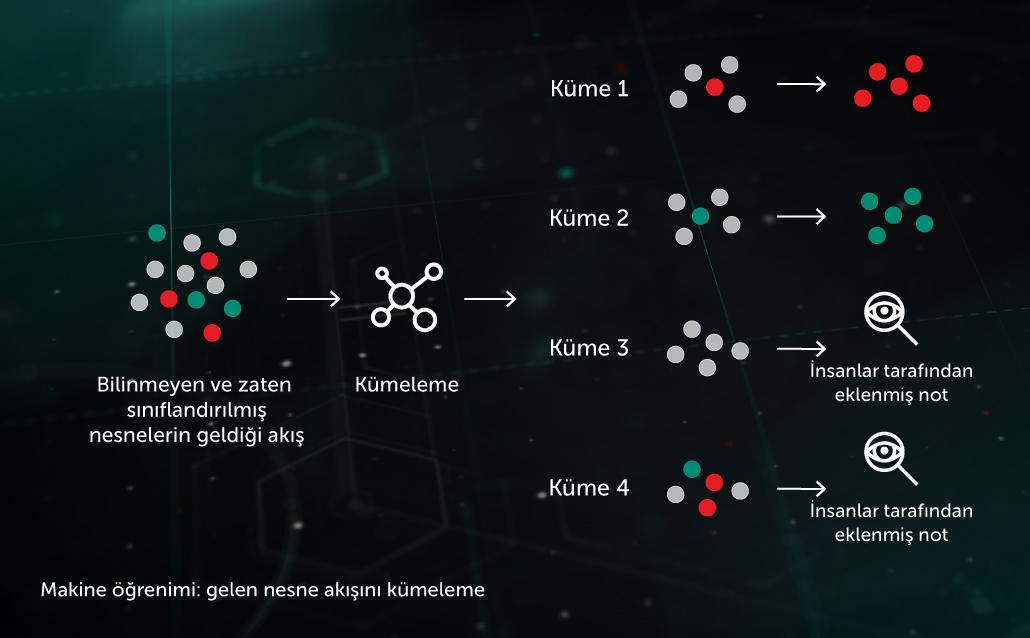

Gelen Akışı Kümeleme

ML tabanlı kümeleme algoritmaları, altyapımıza gelen büyük hacimli bilinmeyen dosyaları etkili bir şekilde makul sayıdaki kümelere ayırmamıza olanak tanır. Bu kümelerden bazıları, içinde daha önceden not eklenmiş bir nesne bulunuyorsa otomatik olarak işlenebilir.

Büyük Ölçekli Sınıflandırma Modelleri

En güçlü sınıflandırma modellerinden bazıları (devasa bir rastgele karar ağacı gibi), pahalı özellik ayıklayıcıların (ör. ayrıntılı davranış günlükleri için korumalı alan üzerinden işleme gerekebilir) yanı sıra önemli kaynaklar (işlemci süresi, bellek) gerektirir. Bu nedenle modelleri bir laboratuvarda tutmak ve burada çalıştırmak, ardından hafif bir sınıflandırma modelini daha büyük modelin çıktı kararları üzerine eğiterek bu tür modellerle elde edilen bilgileri damıtmak daha verimlidir.

Yapay zekanın makine öğrenimi yönlerinin kullanımında güvenlik

ML algoritmaları, laboratuvar sınırlarından çıkıp gerçek dünyayla tanıştığında, ML sistemlerini kasti hatalar yapmaya zorlamak üzere tasarlanmış birçok saldırı türüne karşı savunmasızdır. Bir saldırgan, eğitim veri setini bozabilir veya modelin koduna tersine mühendislik uygulayabilir. Ayrıca bilgisayar korsanları, özel olarak geliştirilmiş “düşman yapay zeka” sistemlerinin yardımıyla makine öğrenimi modellerini “kaba kuvvetle” zorlayabilir, böylece otomatik olarak çok sayıda saldırı örneği oluşturabilir ve modelin zayıf bir noktası keşfedilene kadar bunları koruyucu çözüme veya çıkarılan makine öğrenimi modeline karşı başlatabilir. Bu tür saldırıların yapay zekayı kullanan kötü amaçlı yazılımdan koruma sistemleri üzerinde yıkıcı bir etkisi olabilir: Yanlış tanımlanan bir Trojan, milyonlarca cihaza virüs bulaştırarak milyonlarca dolar zarara sebep olabilir.

Bu nedenle, güvenlik sistemlerinde yapay zeka kullanılırken dikkat edilmesi gereken bazı temel hususlar vardır:

- Güvenlik çözümü tedarikçisi, gerçek ve muhtemelen düşmanca bir dünyada yapay zeka unsurlarının performansına yönelik temel gereklilikleri (potansiyel düşmanlara karşı sağlamlık da dahil) anlamalı ve dikkatle ele almalıdır. Makine öğrenimi/YZ'ye özgü güvenlik denetimleri ve “kırmızı takım”, yapay zekanın özelliklerini kullanan güvenlik sistemlerinin geliştirilmesinde kilit bileşenler olmalıdır.

- Yapay zeka unsurlarını kullanan bir çözümün güvenliğini değerlendirirken, çözümün üçüncü taraf verilerine ve mimarilerine ne ölçüde bağlı olduğunu sorun, çünkü birçok saldırı üçüncü taraf girdisine dayanmaktadır (tehdit istihbaratı beslemeleri, genel veri kümeleri, önceden eğitilmiş ve dış kaynaklı yapay zeka modelleri).

- Makine öğrenimi/YZ yöntemleri sihirli bir değnek olarak görülmemeli, tamamlayıcı koruma teknolojilerinin ve insan uzmanlığının birlikte çalıştığı, birbirinin arkasını kollayan çok katmanlı bir güvenlik yaklaşımının parçası olmalıdır.

Kaspersky, siber güvenlik çözümlerinde makine öğrenimi ve Derin Öğrenme alt kümesi gibi yapay zeka unsurlarının verimli kullanımı konusunda kapsamlı deneyime sahip olsa da, bu teknolojilerin gerçek yapay zeka veya Yapay Genel Zeka (AGI) olmadığını kabul etmek önemlidir. Makinelerin bağımsız olarak çalışabilmesi ve çoğu görevi tamamen otonom olarak yerine getirebilmesi için daha gidilecek çok yol var. O zamana kadar, siber güvenlikte yapay zekanın neredeyse her alanında, sistemleri geliştirmek ve iyileştirmek için insan profesyonellerin rehberliğine ve uzmanlığına ihtiyaç duyulacak ve zaman içinde yetenekleri artacaktır.

Makine öğrenimi/YZ algoritmalarını hedef alan popüler saldırılar ve bu tehditlerden korunma yöntemlerine ilişkin daha ayrıntılı inceleme için tanıtım belgemizi okuyun: "AI Under Attack: How to Secure Machine Learning in Security System" (YZ Saldırı Altında: Güvenlik Sisteminde Makine Öğrenimini Güvence Altına Alma).

İlgili Ürünler

İlgili Teknolojiler

Whitepaper

Whitepaper

Whitepaper

WhitepaperMachine Learning for Malware Detection

Whitepaper

Whitepaper

Whitepaper

WhitepaperMachine learning and Human Expertise

Whitepaper

Whitepaper

Whitepaper

WhitepaperAI under Attack: How to Secure Machine Learning in Security System